Британское агентство выпустило инструменты для проверки безопасности моделей ИИ

Набор инструментов призван "укрепить безопасность ИИ", облегчив промышленным предприятиям, исследовательским организациям и научным кругам разработку оценок ИИ

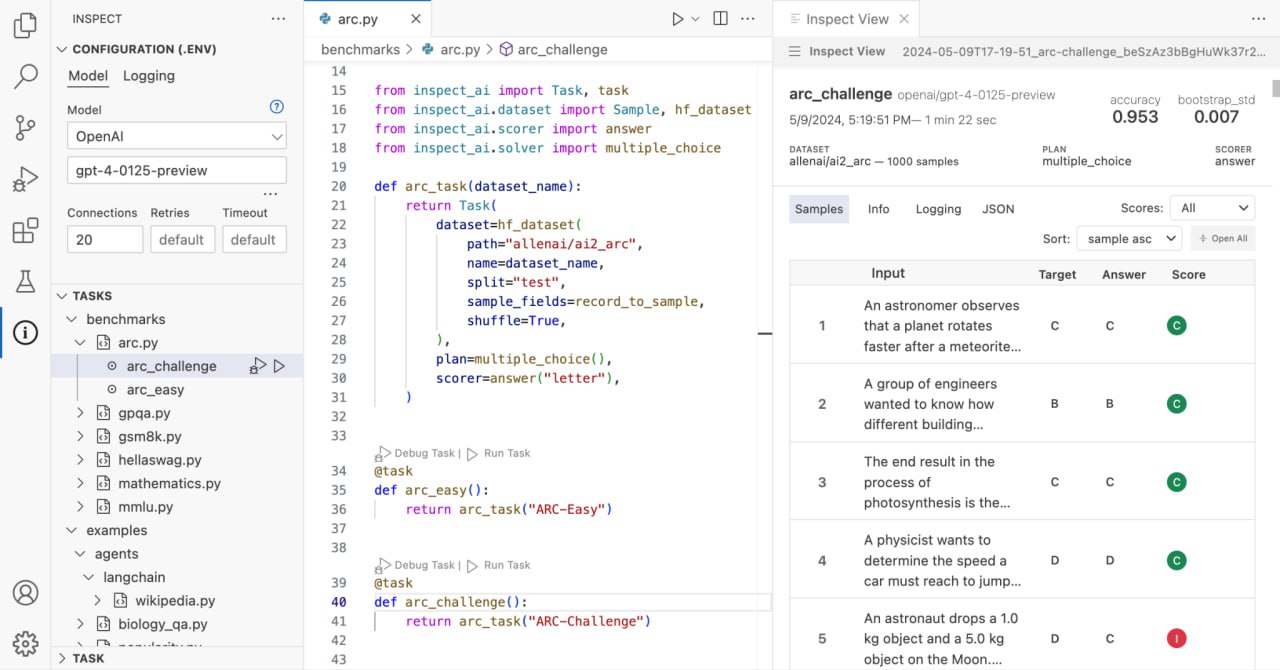

Инструментарий под названием Inspect, доступный под лицензией с открытым исходным кодом, предназначен для оценки определенных возможностей моделей ИИ, включая базовые знания и способность рассуждать, и генерирования оценки на основе полученных результатов.

В пресс-релизе Институт безопасности заявил, что Inspect - это "первый случай, когда платформа для тестирования безопасности ИИ, созданная при поддержке государства, была выпущена для широкого использования".

Inspect состоит из трех основных компонентов: наборов данных, решателей и оценщиков. Наборы данных предоставляют образцы для оценочных тестов. Решатели выполняют работу по проведению тестов. А счетчики оценивают работу решателей и объединяют оценки тестов в метрики.

Встроенные компоненты Inspect могут быть дополнены сторонними пакетами, написанными на Python.

Выпуск Inspect состоялся после того, как государственное агентство США - Национальный институт стандартов и технологий (NIST) - запустило NIST GenAI, программу по оценке различных технологий генеративного ИИ, включая ИИ, генерирующий тексты и изображения. NIST GenAI планирует выпустить контрольные показатели, помочь в создании систем определения подлинности контента и стимулировать разработку программного обеспечения для выявления поддельной или вводящей в заблуждение информации, генерируемой ИИ.

В апреле США и Великобритания объявили о партнерстве для совместной разработки передовых испытаний моделей ИИ, следуя обязательствам, объявленным на саммите по безопасности ИИ в Блетчли-парке в ноябре прошлого года. В рамках сотрудничества США намерены создать собственный институт безопасности ИИ, в задачи которого будет входить оценка рисков, связанных с ИИ и генеративным ИИ.

Набор инструментов призван "укрепить безопасность ИИ", облегчив промышленным предприятиям, исследовательским организациям и научным кругам разработку оценок ИИ

Инструментарий под названием Inspect, доступный под лицензией с открытым исходным кодом, предназначен для оценки определенных возможностей моделей ИИ, включая базовые знания и способность рассуждать, и генерирования оценки на основе полученных результатов.

В пресс-релизе Институт безопасности заявил, что Inspect - это "первый случай, когда платформа для тестирования безопасности ИИ, созданная при поддержке государства, была выпущена для широкого использования".

Inspect состоит из трех основных компонентов: наборов данных, решателей и оценщиков. Наборы данных предоставляют образцы для оценочных тестов. Решатели выполняют работу по проведению тестов. А счетчики оценивают работу решателей и объединяют оценки тестов в метрики.

Встроенные компоненты Inspect могут быть дополнены сторонними пакетами, написанными на Python.

Выпуск Inspect состоялся после того, как государственное агентство США - Национальный институт стандартов и технологий (NIST) - запустило NIST GenAI, программу по оценке различных технологий генеративного ИИ, включая ИИ, генерирующий тексты и изображения. NIST GenAI планирует выпустить контрольные показатели, помочь в создании систем определения подлинности контента и стимулировать разработку программного обеспечения для выявления поддельной или вводящей в заблуждение информации, генерируемой ИИ.

В апреле США и Великобритания объявили о партнерстве для совместной разработки передовых испытаний моделей ИИ, следуя обязательствам, объявленным на саммите по безопасности ИИ в Блетчли-парке в ноябре прошлого года. В рамках сотрудничества США намерены создать собственный институт безопасности ИИ, в задачи которого будет входить оценка рисков, связанных с ИИ и генеративным ИИ.