Там вышедший час назад убийца нейросетей производит небывалый фурор среди исследователей. Сейчас все расскажем ⬇️

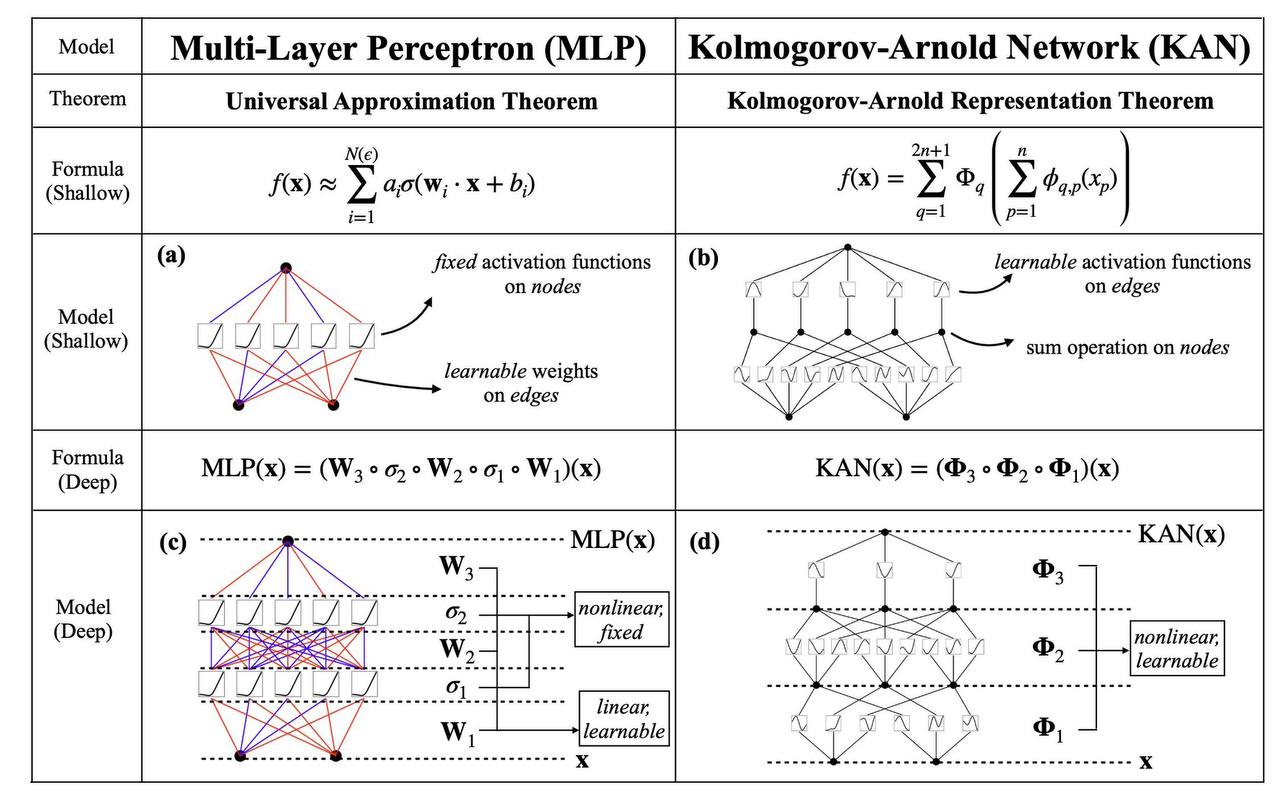

В основе всех архитектур, к которым мы привыкли, лежит многослойный перцептрон (MLP). У него есть веса и нейроны, в которых расположены функции активации.

А что, если мы переместим функции активации на веса и сделаем из обучаемыми? Звучит как бред, но yes, we KAN.

KAN (Kolmogorov-Arnold Networks) - новая парадигма, в которой исследователи реализовали перемещение активаций на «ребра» сети. Кажется, что решение взято из ниоткуда, но на самом деле тут зашита глубокая связь с математикой: в частности, с теоремами универсальной аппроксимации и аппроксимации Колмогорова-Арнольда.

Не будем вдаваться в детали. Главное: KAN работает намного точнее, чем MLP гораздо большего размера, и к тому же лучше интерпретируется. Единственный минус: из-за обучаемых активаций тренится все это дело в разы дороже и дольше, чем MLP.

И тем не менее, возможно сегодня мы наблюдаем рождение Deep Learning 2.0. Ведь такой подход меняет вообще все, от LSTM до трансформеров.

Статья | Код

В основе всех архитектур, к которым мы привыкли, лежит многослойный перцептрон (MLP). У него есть веса и нейроны, в которых расположены функции активации.

А что, если мы переместим функции активации на веса и сделаем из обучаемыми? Звучит как бред, но yes, we KAN.

KAN (Kolmogorov-Arnold Networks) - новая парадигма, в которой исследователи реализовали перемещение активаций на «ребра» сети. Кажется, что решение взято из ниоткуда, но на самом деле тут зашита глубокая связь с математикой: в частности, с теоремами универсальной аппроксимации и аппроксимации Колмогорова-Арнольда.

Не будем вдаваться в детали. Главное: KAN работает намного точнее, чем MLP гораздо большего размера, и к тому же лучше интерпретируется. Единственный минус: из-за обучаемых активаций тренится все это дело в разы дороже и дольше, чем MLP.

И тем не менее, возможно сегодня мы наблюдаем рождение Deep Learning 2.0. Ведь такой подход меняет вообще все, от LSTM до трансформеров.

Статья | Код